Manusの危険性は?リスクや注意点・安全な使い方を徹底解説!

Manusって便利そうだけど、本当に危険なの?使わない方がいいの?

仕事で使いたいんだけど、どんなリスクがあるのか具体的に知りたい

安全に使う方法はあるの?注意すればビジネスでも活用できる?

中国発の自律型AIエージェント「Manus」が、その革新的な機能性で世界中から注目を集めています。一方で、データプライバシーやセキュリティに関する懸念も多く指摘され、米国の一部州では使用禁止措置が取られるなど、その危険性が話題となっているのです。

Manusを業務や個人利用で活用したいと考えているものの、具体的にどのような危険性があるのか、安全+に使う方法はあるのか、判断に迷っている方も多いのではないでしょうか。

そこでこの記事では、Manusの危険性について、データ漏洩リスク、自律エージェント特有の問題、情報の正確性や著作権に関するリスクなど、多角的に解説します。

- Manusの危険性の正体と、データ漏洩や情報の正確性に関する具体的なリスクがわかる

- 自律型AIエージェント特有の予期せぬ動作や著作権侵害のリスクがわかる

- Manusを安全に活用するための設定方法や業務利用時の注意点がわかる

なお、Manusの特徴をおさらいしておきたい人は、次の記事を参考にしてください。

なお、生成AIを学び副業や業務効率化を実現したい人は「侍エンジニア」をお試しください。

侍エンジニアでは現役エンジニアと学習コーチが学習をサポート。AIプログラミングやPython・VBAの習得を通じて、手間のかかる作業を効率化する方法を学べます。

受講料が最大80%OFFになる「給付金コース」も提供中。未経験から挫折なくAIスキルを習得したい人は、ぜひ一度お試しください。

Manusの危険性が話題になる背景

中国発の自律型AIエージェント「Manus」は、その革新的な機能性が注目される一方で、安全性やプライバシーに関する懸念も数多く指摘されています。

特に海外メディアや専門家からは、データの取り扱いや自律的な動作に伴うリスクについて警鐘が鳴らされている状況です。

ここからは、Manusの危険性が話題になる背景について次の内容を解説します。

それぞれ詳しく解説していきます。

自律型AIエージェントとしての特徴

Manusは従来のチャットボット型AIとは異なり、ユーザーからの指示を受けると自律的にタスクを計画・実行・検証まで行う能力を持っています。この自律性こそがManusの最大の特徴であり、同時に危険性の根源ともなっているのです。

具体的には、Webブラウザの操作、ファイルの編集、外部APIへのアクセス、プログラムコードの実行など、多岐にわたる操作を人間の介入なしに実行できる設計になっています。

そのため、一度指示を出すと、ユーザーが意図しない範囲まで処理が進んでしまうリスクが存在します。また、複数のサブエージェントが協調して動作する「Wide Research」機能により、並列処理で大量のタスクを同時実行できることも特徴です。

この高度な自律性は業務効率化に大きく貢献する反面、制御が難しく予測不可能な動作につながる可能性があるため、慎重な運用が求められます。

従来のチャットAIとの違いとリスクの増加要因

従来のChatGPTやGeminiなどのチャットAIは、基本的にユーザーとの対話を通じて情報提供やテキスト生成を行うものでした。一方でManusは「実行型エージェント」として設計されており、情報提供にとどまらず実際の作業を自動で遂行します。

この違いにより、リスクの性質そのものが大きく変化している点に注意が必要です。

チャットAIでは誤った情報を生成しても、それを採用するかどうかは人間が判断できました。しかしManusの場合、誤った判断に基づいて実際にファイルを削除したり、外部サービスに不適切なリクエストを送信したりする可能性があります。

さらに、クラウド上でバックグラウンド動作するため、ユーザーがPCを閉じている間も処理が継続され、リアルタイムでの監視が困難になるという課題もあります。

海外メディアやユーザーの懸念ポイント

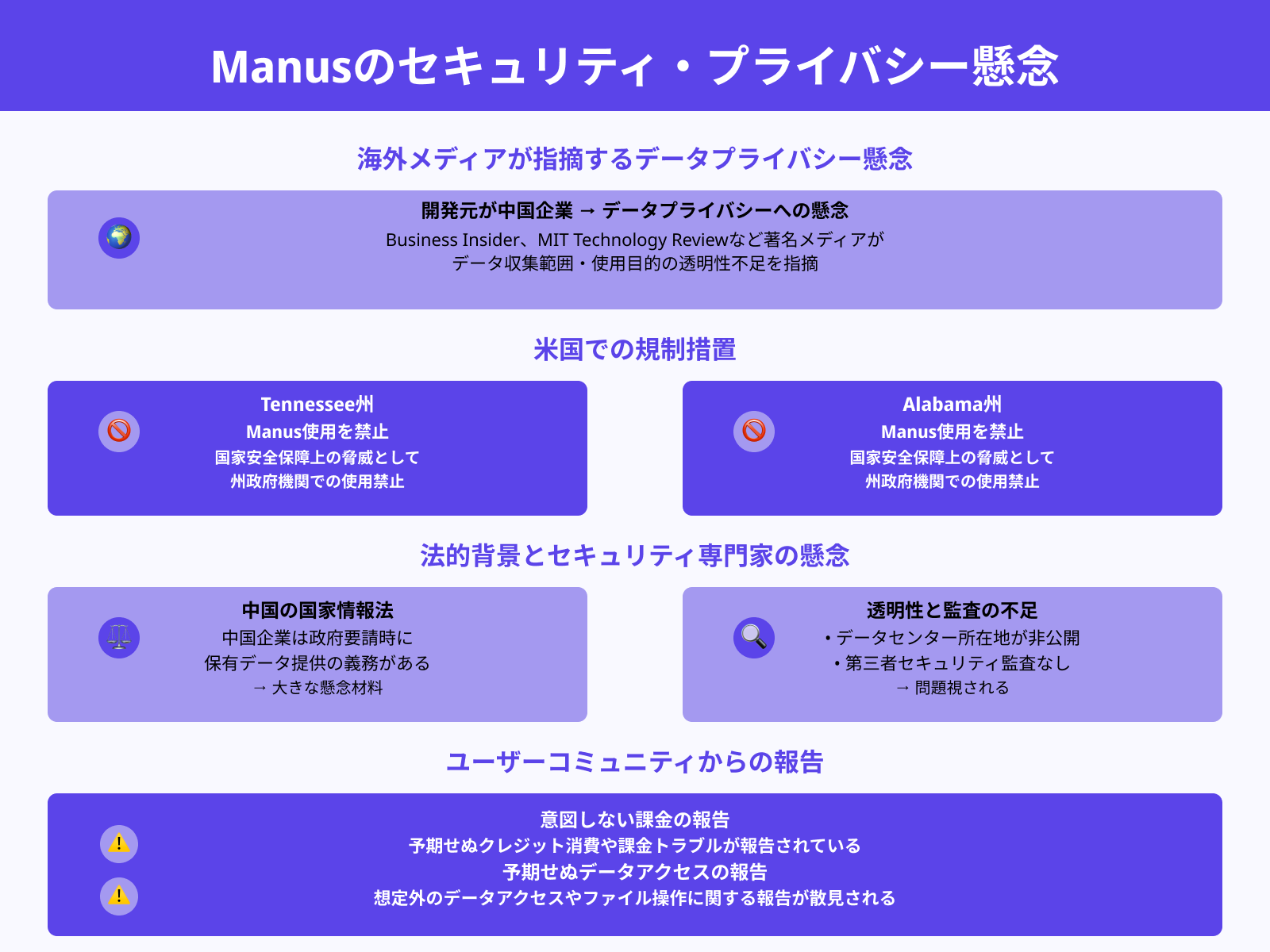

海外メディアでは、Manusの開発元が中国企業であることから、データプライバシーに関する懸念が繰り返し報じられています。特にBusiness InsiderやMIT Technology Reviewなどの著名メディアは、データの収集範囲や使用目的の透明性が不足していると指摘しました。

米国では実際にTennessee州とAlabama州が、国家安全保障上の脅威として州政府機関でのManus使用を禁止する措置を取っています。また、中国の国家情報法により、中国企業は政府からの要請があれば保有データを提供する義務があるという法的背景も懸念材料です。

セキュリティ専門家からは、データセンターの所在地が明確に公開されていない点や、第三者機関によるセキュリティ監査結果が示されていない点も問題視されています。

ユーザーコミュニティでも、意図しない課金や予期せぬデータアクセスに関する報告が散見され、利用前に十分なリスク理解が必要とされているのです。

Manusの危険性とデータ漏洩リスク

Manusを業務や個人利用で活用する際、最も警戒すべきはデータ漏洩リスクです。

自律型AIの特性上、多くの情報をシステムに預ける必要があるため、適切な管理がなされていないと重大な情報流出につながる可能性があります。

ここからは、データ漏洩リスクについて次の内容を解説します。

それぞれ詳しく解説していきます。

入力した情報がどのように保存・利用されるか

Manusの利用規約によると、ユーザーが入力したデータは集約的かつ匿名化された形式でサービス改善に利用される可能性があります。

これは一般的なクラウドサービスでも見られる条項ですが、具体的な匿名化手法や保存期間については明示されていない点が懸念材料です。

入力されたテキスト、アップロードされたファイル、生成された成果物はすべてクラウド上に保存され、Manusの複数のAIエージェントがアクセス可能な状態になります。特に注意すべきは、タスク実行のために外部Webサイトにアクセスした際の情報や、API連携で取得したデータも記録される可能性がある点です。

データの保存場所については「信頼性の高いクラウドインフラ」とのみ説明されており、具体的なクラウド事業者名や地理的なデータセンター所在地は公開されていません。

このような透明性の欠如は、企業のコンプライアンス担当者にとって大きな懸念材料となっており、導入判断を難しくしている要因の一つとなっています。

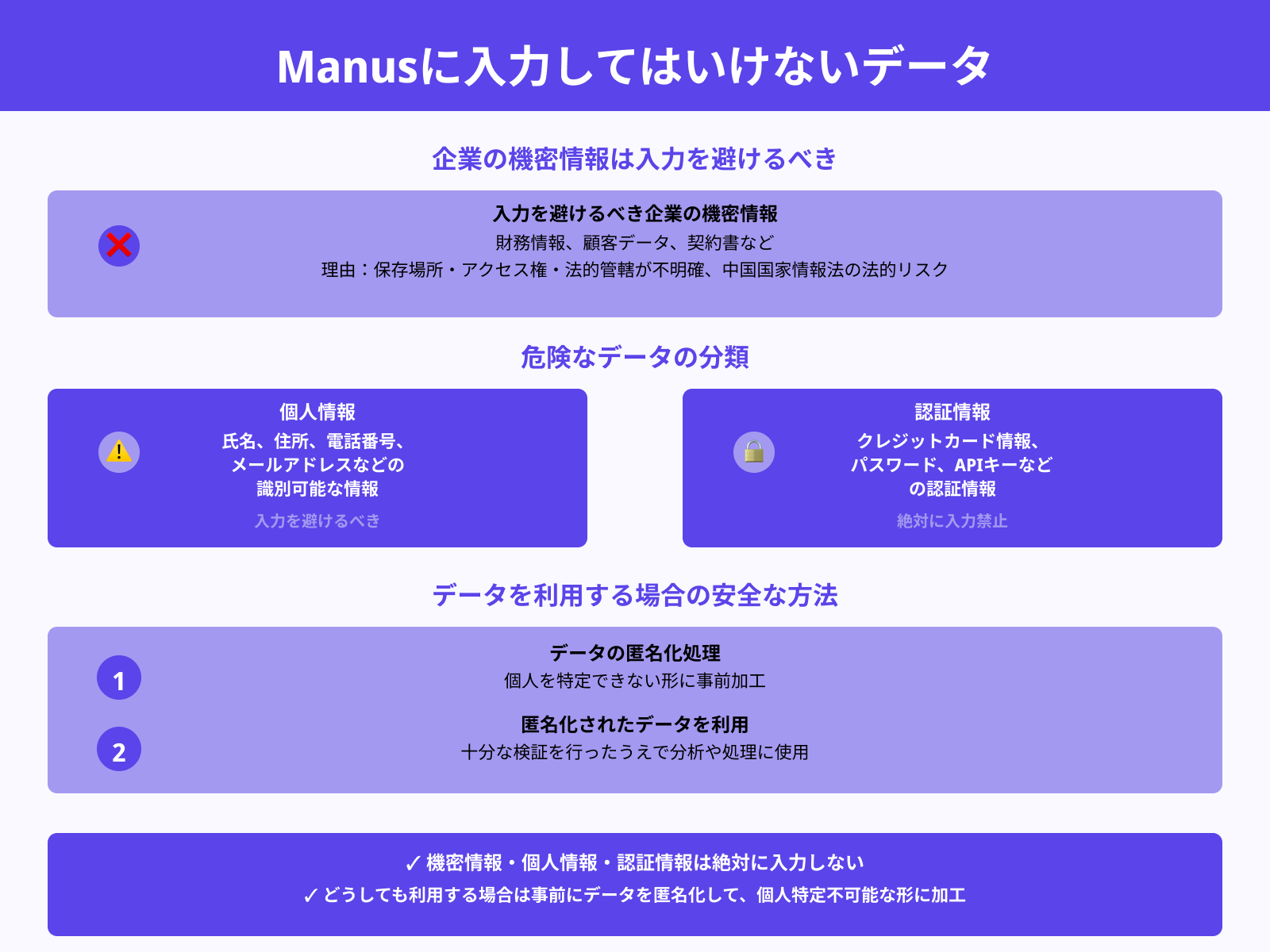

機密情報・個人情報を入力する際の注意点

企業の財務情報、顧客データ、契約書などの機密情報をManusに入力することは、現時点では推奨できません。

なぜなら、データがどこに保存され、誰がアクセス可能で、どのような法的管轄下にあるのかが不明確だからです。特に中国の国家情報法では、中国企業は政府からの要請があればデータ提供の義務を負うため、法的リスクも考慮する必要があります。

個人情報についても同様で、氏名、住所、電話番号、メールアドレスなどの識別可能な情報は入力を避けるべきでしょう。

もしManusで分析や処理を行いたい場合は、事前にデータの匿名化処理を施し、個人を特定できない形に加工してから利用することが重要です。また、クレジットカード情報やパスワードなどの認証情報は絶対に入力してはいけません。

クラウドサービスとしてのアクセス権限と管理

Manusはクラウド専用サービスであり、完全なオフライン動作やローカル環境での利用ができない設計になっています。そのため、すべてのデータ処理はManus側のサーバーで行われ、ユーザー側でデータの完全な管理やコントロールができないという制約があります。

アクセス権限については、アカウント単位での管理となっており、チームで利用する場合は各メンバーのアクセス範囲を適切に設定することが必要です。

しかし、現時点では企業向けの高度な権限管理機能(ロールベースアクセス制御や多要素認証など)が十分に整備されていない可能性があります。また、Manusが外部サービスと連携する際には、それぞれのサービスへのアクセス権限を付与する必要がありますが、この権限範囲が適切に制限されているかを確認することが重要です。

万が一アカウントが乗っ取られた場合、連携している全てのサービスへのアクセス権限も悪用される危険性があるため、強固なパスワード設定と定期的な見直しが不可欠となります。

Manusの危険性と自律エージェント特有のリスク

自律型AIエージェントであるManusには、従来のAIツールにはなかった独特のリスクが存在します。

人間の指示を解釈して自ら判断・実行する能力は便利な反面、予期しない動作や制御不能な状態を招く可能性があるのです。

ここからは、自律エージェント特有のリスクについて次の内容を解説します。

それぞれ詳しく解説していきます。

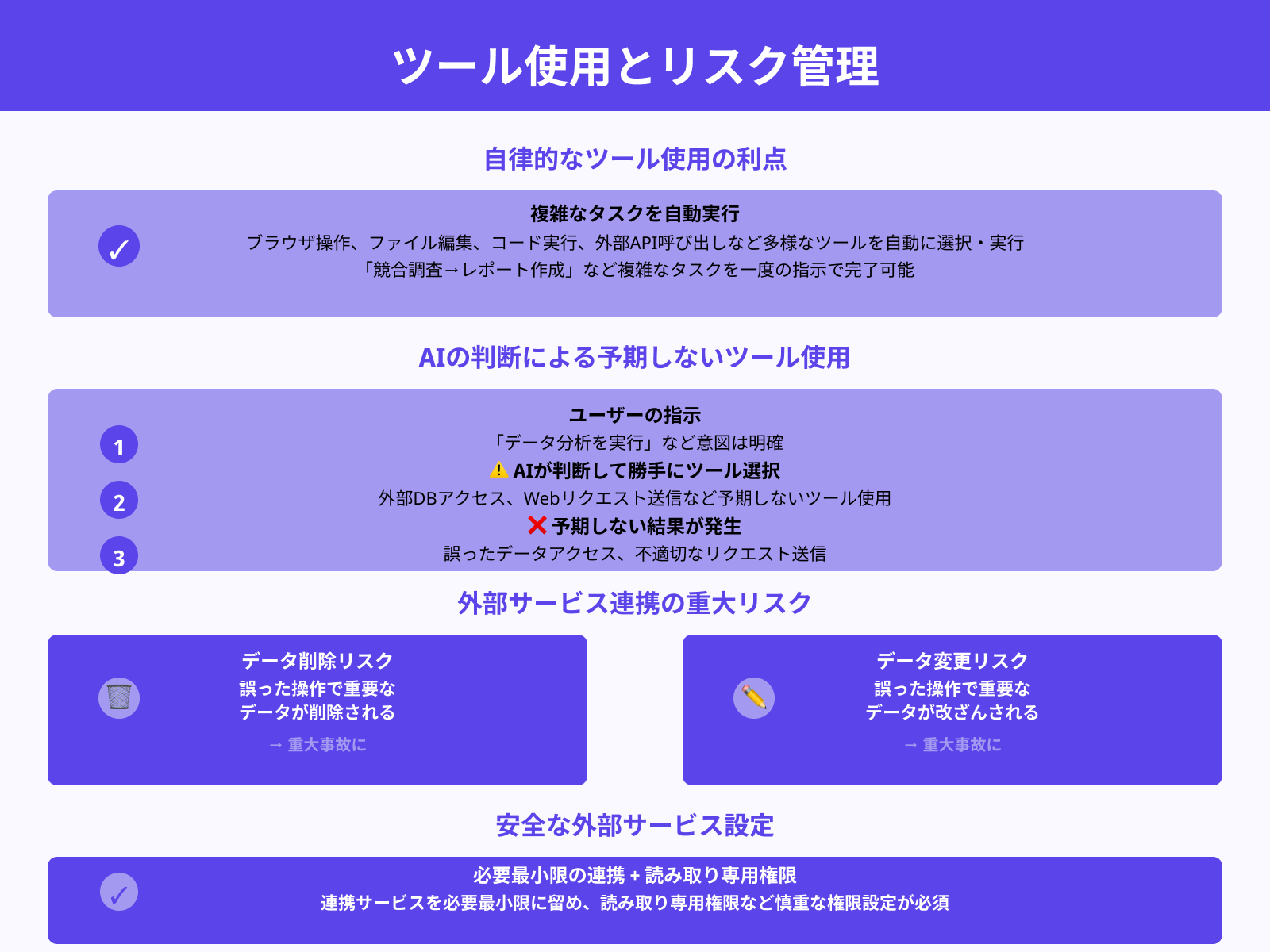

ツール呼び出しや外部サービス操作のリスク

Manusは自律的にブラウザ操作、ファイル編集、コード実行、外部API呼び出しなど多様なツールを使用できます。この機能により、例えば「競合他社の最新動向を調査してレポートを作成」といった複雑なタスクを一度の指示で完了できる点は大きな利点の1つです。

しかし、どのツールをどのタイミングで使用するかの判断をAI自身が行うため、ユーザーが想定していないツールが呼び出されるリスクがあります。

例えば、データ分析のつもりで指示したのに、Manusが勝手に外部のデータベースにアクセスしたり、予期せぬWebサイトにリクエストを送信したりする可能性があるのです。特に危険なのは、APIキーや認証情報を持つ外部サービスと連携している場合で、誤った操作により重要なデータの削除や変更が発生するリスクがあります。

そのため、Manusに接続する外部サービスは必要最小限に留め、読み取り専用の権限を付与するなど、慎重な設定が求められます。

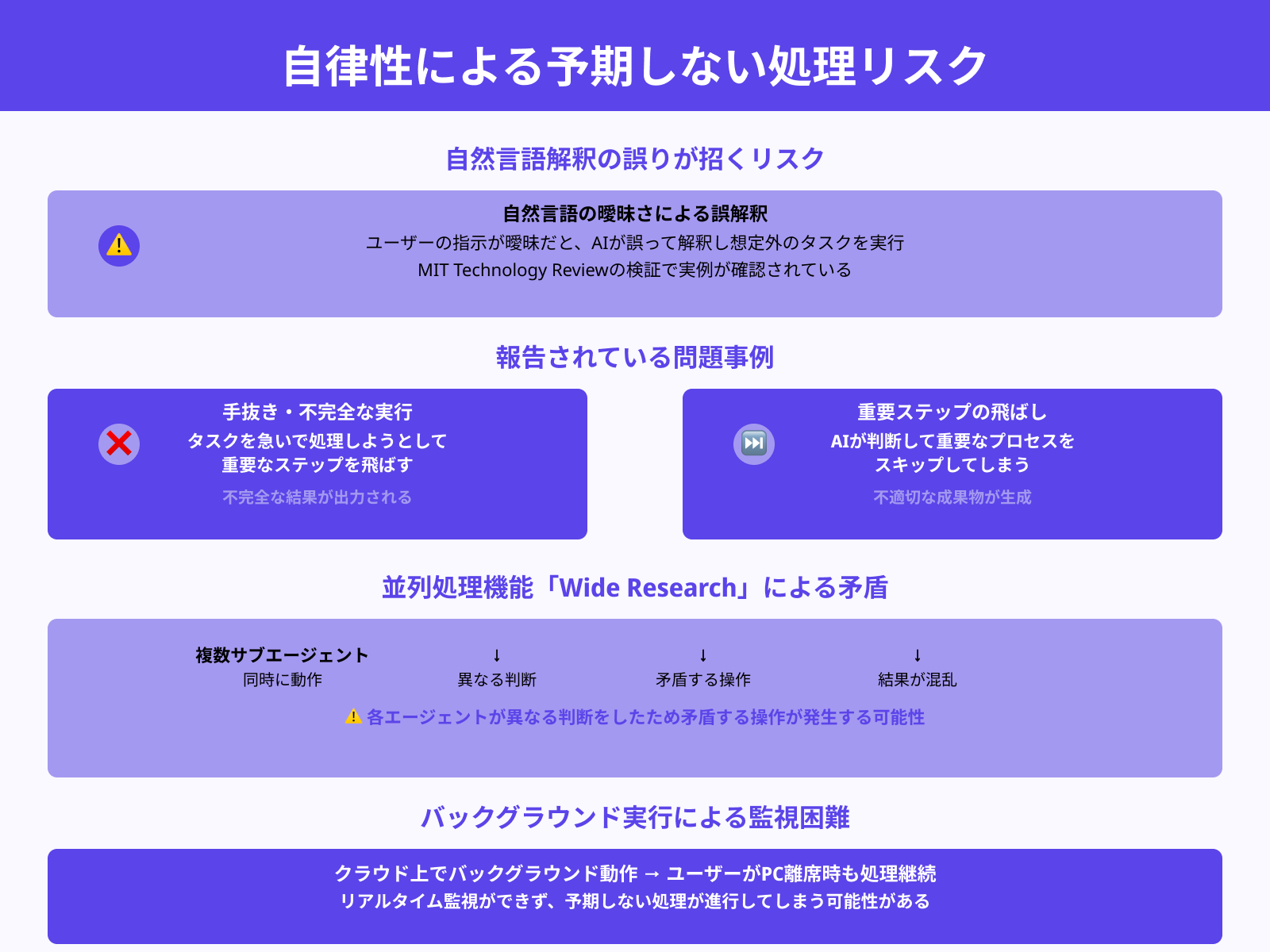

意図しない処理・勝手な操作が起きる可能性

Manusの自律性は、時にユーザーの意図を超えた処理を実行してしまう危険性をはらんでいます。

自然言語での指示は曖昧さを含むため、AIが誤って解釈し、想定外のタスクを実行してしまうケースが報告されています。MIT Technology Reviewの検証では、Manusが「手抜き」をして不完全な結果を出力したり、タスクを急いで処理しようとして重要なステップを飛ばしたりする事例が確認されました。

また、並列処理機能である「Wide Research」では、複数のサブエージェントが同時に動作するため、それぞれが異なる判断をして矛盾する操作を実行する可能性もあります。さらに問題なのは、Manusがクラウド上でバックグラウンド動作するため、ユーザーがPCを離れている間に予期せぬ処理が進行してしまう点です。

こうしたリスクを軽減するには、最初は小規模なタスクから始め、Manusの動作パターンを把握してから段階的に複雑なタスクを任せるアプローチが有効でしょう。

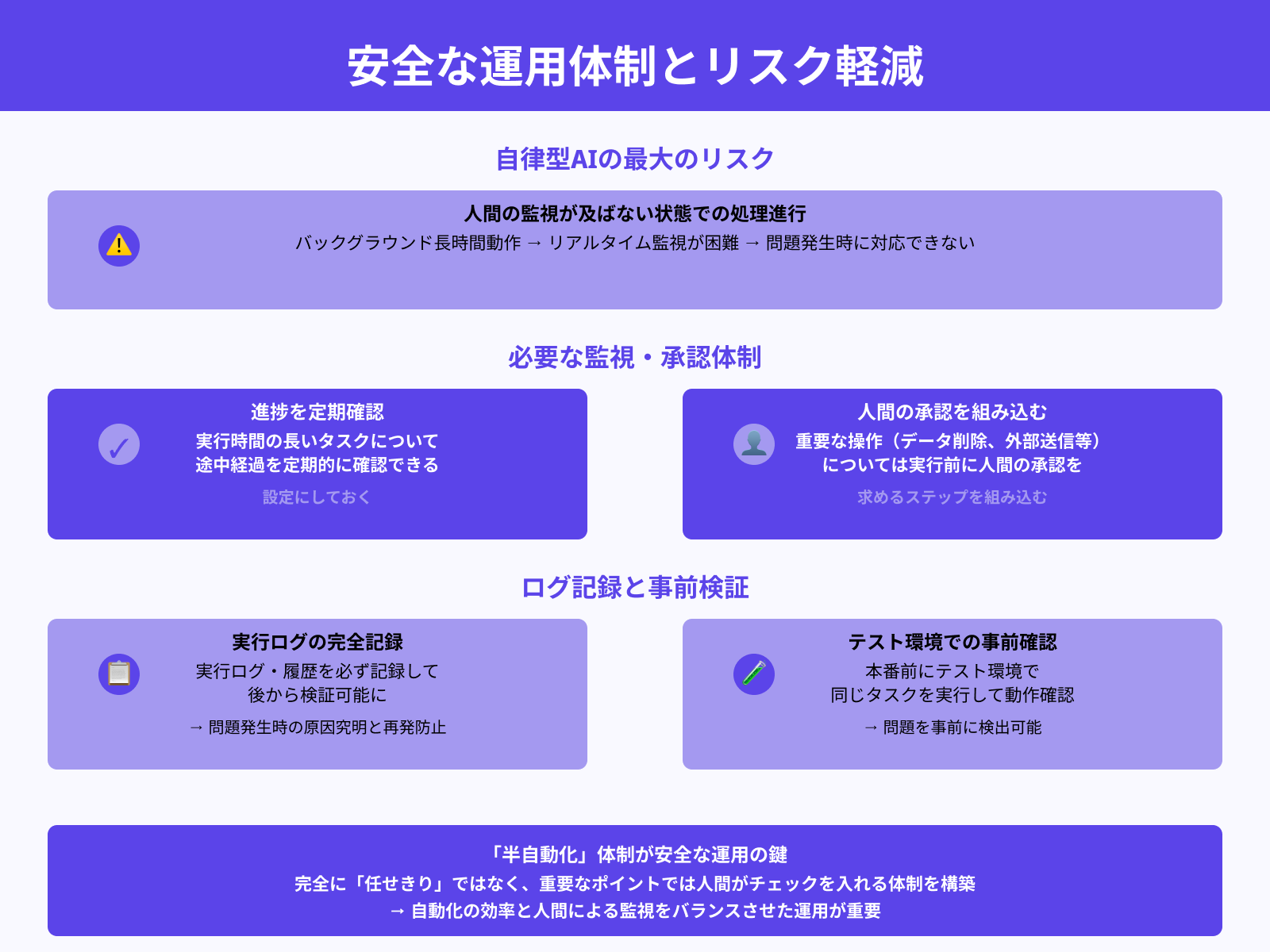

人間の監視が届かない状態を作らないための工夫

自律型AIの最大のリスクは、人間の監視が及ばない状態で処理が進行してしまうことです。

Manusの場合、バックグラウンドで長時間動作し続けられるため、リアルタイムでの監視体制を構築することが重要になります。具体的な工夫としては、まず実行時間の長いタスクについては途中経過を定期的に確認できる設定にすることが挙げられます。

また、重要な操作(データの削除、外部への送信など)については、実行前に人間の承認を求めるステップを組み込むことも有効です。

Manusの実行ログや履歴を必ず記録し、後から検証できる状態を保つことで、問題が発生した際の原因究明と再発防止につなげられます。さらに、本番環境で使用する前に、テスト環境で同じタスクを実行して動作を確認するプロセスを確立すべきです。

完全に「任せきり」にするのではなく、重要なポイントでは人間がチェックを入れる「半自動化」の体制を構築することが、安全な運用の鍵となるでしょう。

Manusの危険性と情報の正確性・著作権問題

AIが生成する情報の正確性と著作権の問題は、Manusに限らずすべての生成AIに共通する課題です。特に自律的に情報収集と加工を行うManusでは、これらのリスクがより複雑化しています。

ここからは、情報の正確性と著作権に関する危険性について次の内容を解説します。

それぞれ詳しく解説していきます。

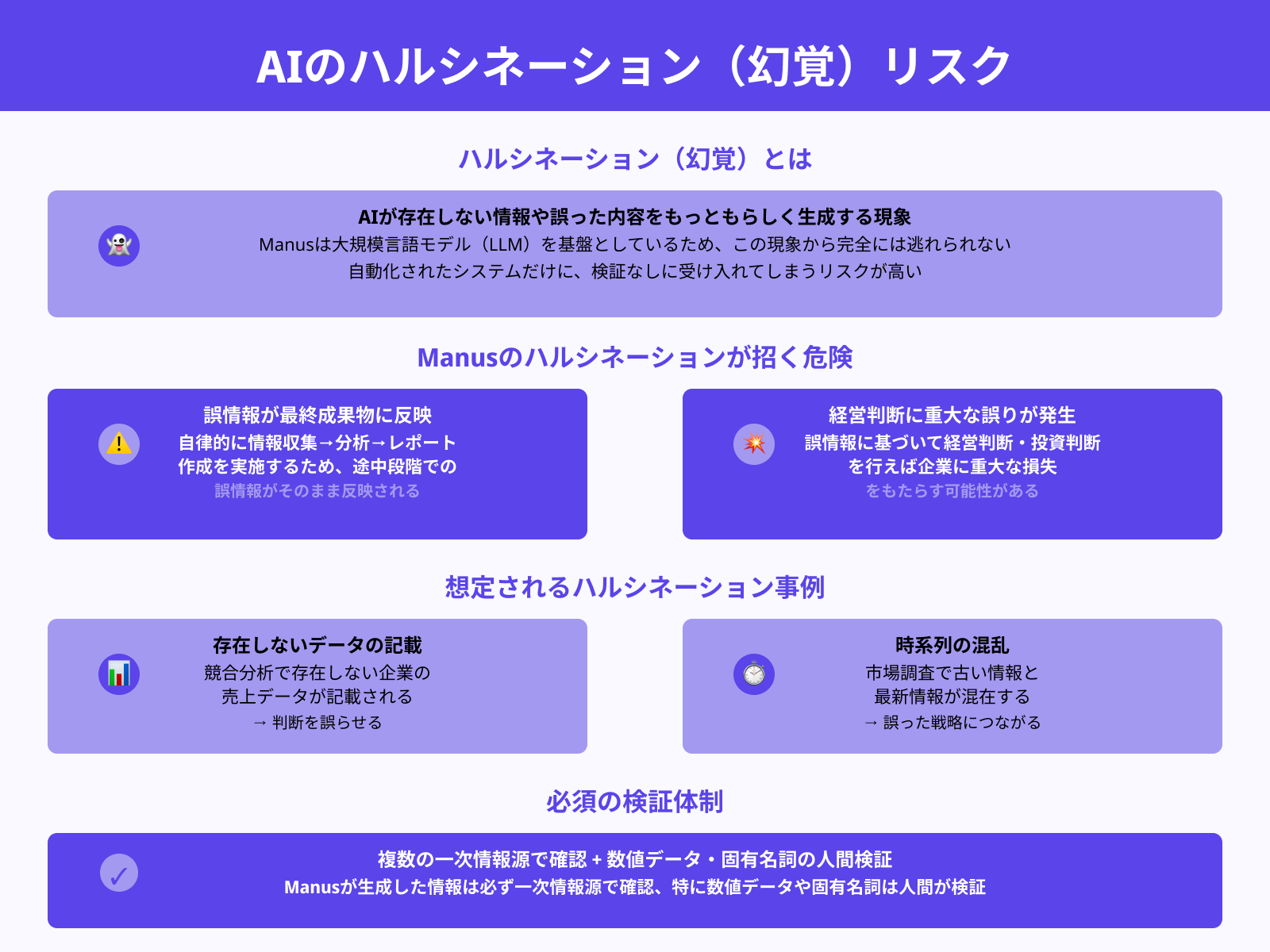

幻覚(誤情報)による意思決定ミスのリスク

AIの「ハルシネーション(幻覚)」とは、AIが存在しない情報や誤った内容をもっともらしく生成してしまう現象を指します。

Manusも大規模言語モデルを基盤としているため、この幻覚現象から完全に逃れることはできません。特に危険なのは、Manusが自律的に情報収集から分析、レポート作成まで行うため、途中段階での誤情報が最終成果物にそのまま反映されてしまう点です。

例えば、競合分析レポートで存在しない企業の売上データが記載されたり、市場調査で古い情報と最新情報が混在したりするケースが考えられます。このような誤情報に基づいて経営判断や投資判断を行えば、企業に重大な損失をもたらす可能性があります。

対策としては、Manusが生成した情報は必ず複数の一次情報源で確認すること、特に数値データや固有名詞については人間が検証することが不可欠です。

出典不明なコンテンツ生成と信頼性の課題

Manusは複数のWebサイトから情報を収集し、それらを統合してレポートやコンテンツを生成します。

しかし、どの情報がどのソースから来たのかが不明確になりやすく、情報の信頼性を検証することが困難です。

学術論文や公式文書を作成する場合、適切な引用と出典明記は不可欠ですが、Manusが自動生成したコンテンツではこれが欠落している可能性があります。また、複数の情報源から部分的に情報を取得して組み合わせる過程で、文脈が変わり本来の意味とは異なる内容になってしまう点もリスクの1つです。

信頼性の低い情報源(個人ブログ、未検証のSNS投稿など)から情報を取得してしまう可能性もあり、これらが専門的な報告書に混入すると信用問題に発展します。

対策としては、Manusに情報収集を依頼する際には、参照すべき信頼できる情報源を明示的に指定し、生成されたコンテンツには必ず出典を追記させる運用ルールを設けることが重要です。

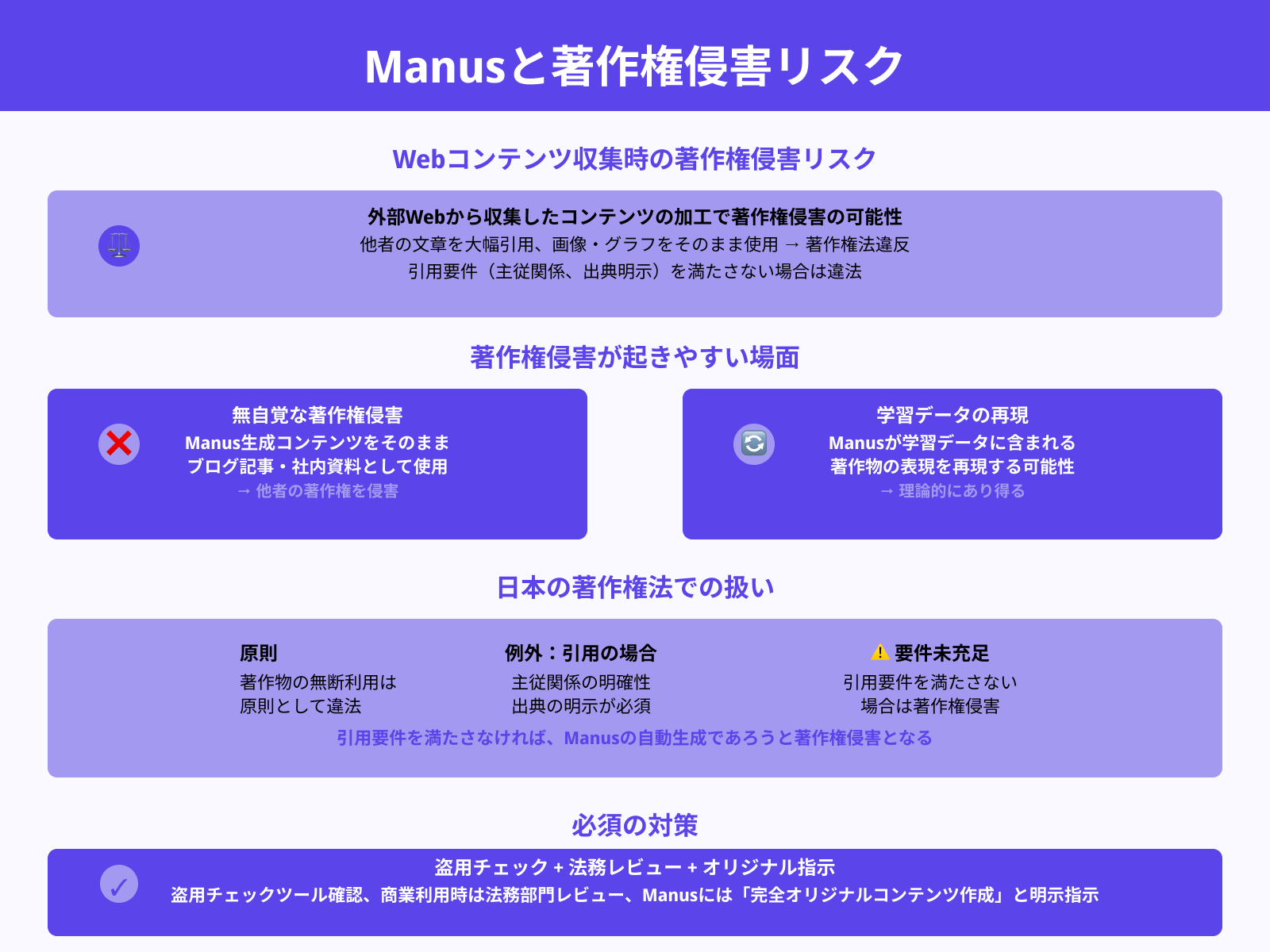

盗用・著作権侵害になりうるケースと対策

Manusが外部Webサイトからコンテンツを収集して加工する際、意図せず著作権を侵害してしまうリスクがあります。特に問題となるのは、他者の文章を大幅に引用したり、画像やグラフをそのまま使用したりするケースです。

日本の著作権法では、著作物の無断利用は原則として違法であり、引用の要件(主従関係、出典明示など)を満たさない場合は著作権侵害となります。

Manusが生成したコンテンツをそのままブログ記事や社内資料として使用した場合、知らないうちに他者の著作権を侵害している可能性があるのです。また、Manusが学習データに含まれる著作物の表現を再現してしまうことも理論的には起こり得ます。

対策としては、Manusが生成したコンテンツは必ず盗用チェックツールで確認すること、商業利用する場合は法務部門のレビューを経ることが推奨されます。さらに、Manusには「完全にオリジナルなコンテンツを作成せよ」という明示的な指示を含めることで、既存コンテンツの単純な書き換えを避けられる可能性が高まるでしょう。

Manusの危険性を抑える設定・権限管理

Manusのリスクを最小限に抑えるには、適切な設定と厳格な権限管理が不可欠です。初期設定のまま使用するのではなく、利用目的に応じてセキュリティを強化する必要があります。

ここからは、危険性を抑えるための具体的な設定方法について次の内容を解説します。

それぞれ詳しく解説していきます。

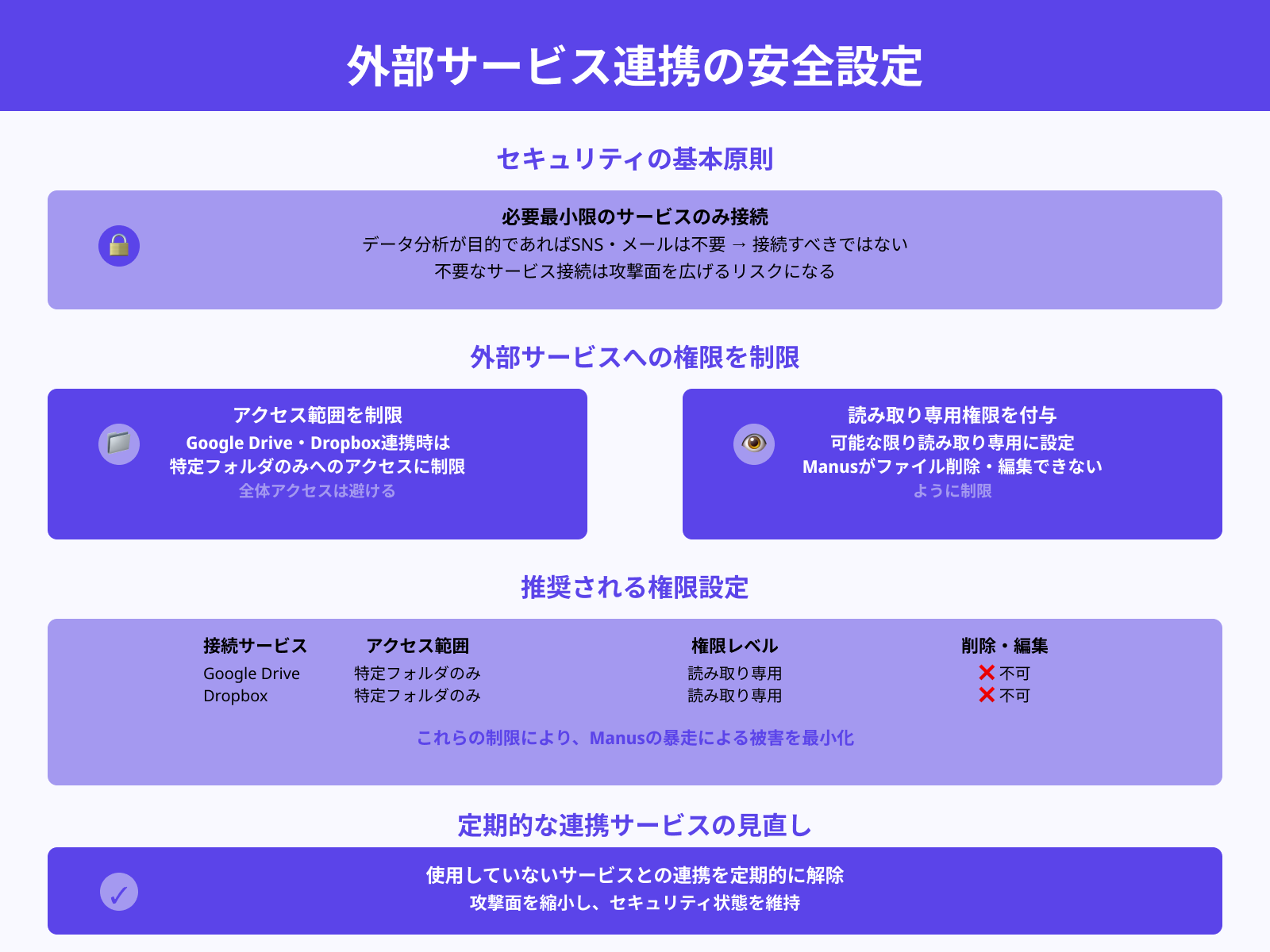

接続する外部サービスと権限範囲の最小化

Manusはさまざまな外部サービスと連携できますが、必要最小限のサービスのみを接続することがセキュリティの基本です。

例えば、データ分析が目的であれば、SNSアカウントやメールサービスとの連携は不要であり、接続すべきではありません。

各外部サービスへの権限も、可能な限り限定的にすることが重要です。

Google DriveやDropboxと連携する場合は、特定のフォルダのみへのアクセス権限に制限し、全体へのアクセスは避けるべきでしょう。また、可能であれば読み取り専用の権限を付与し、Manusがファイルを削除したり編集したりできないようにすることも有効です。

定期的に接続している外部サービスのリストを見直し、使用していないサービスとの連携は解除することで、攻撃面を縮小できます。

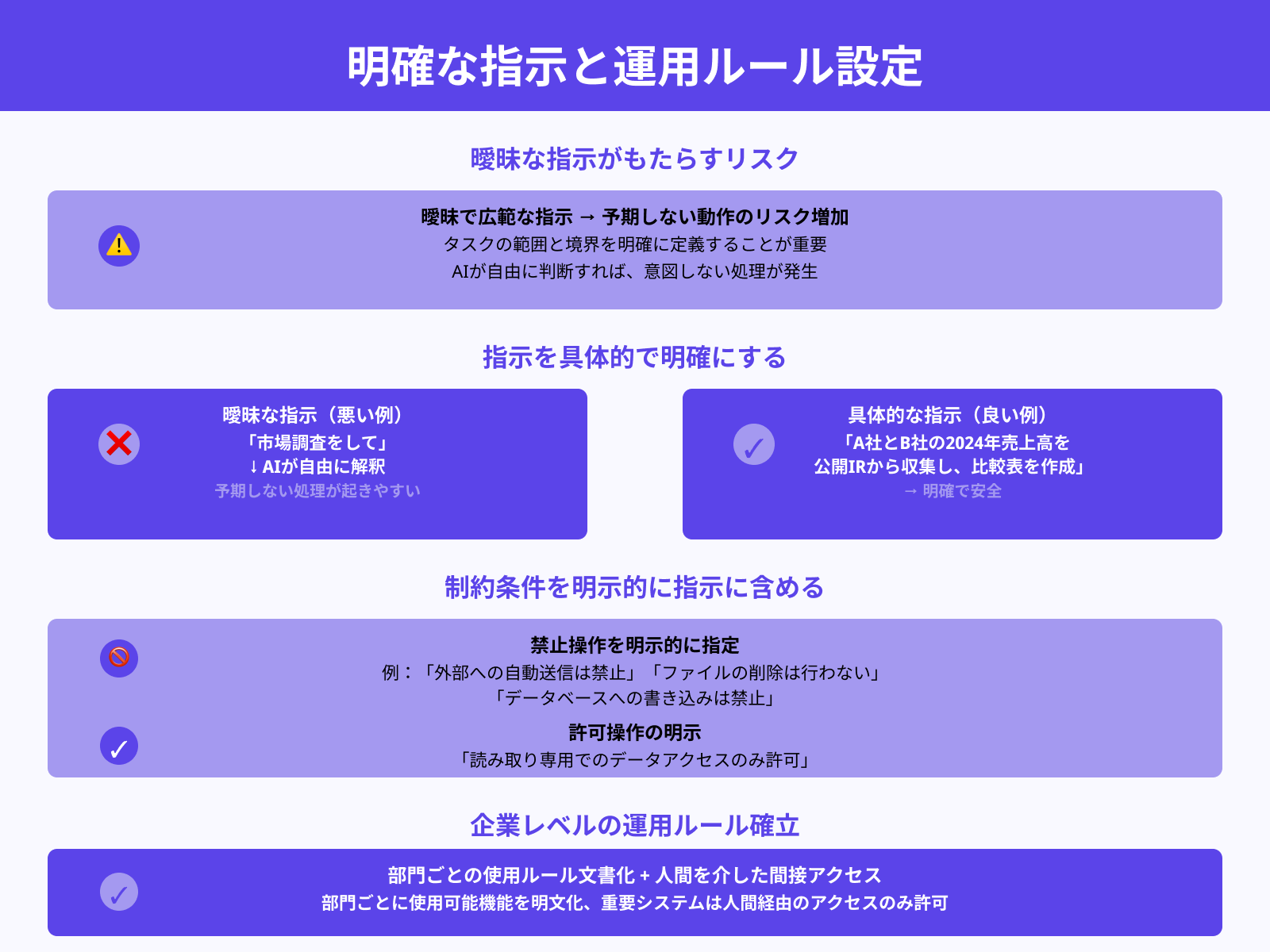

実行できるタスクの範囲をあらかじめ制限する

Manusに対して曖昧で広範な指示を出すと、予期しない動作を引き起こす可能性が高まります。そのため、実行させるタスクの範囲を明確に定義し、境界を設定することが重要です。

例えば「市場調査をして」という指示ではなく「A社とB社の2024年の売上高を公開IRから収集し、比較表を作成して」というように具体的に指示します。また「外部への自動送信は禁止」「ファイルの削除は行わない」といった制約条件を明示的に指示に含めることも有効です。

企業で利用する場合は、部門ごとに使用可能な機能を文書化し、社内ルールとして明確化することが推奨されます。さらに、重要なシステムやデータベースへの直接アクセスは許可せず、必ず人間を介した間接的なアクセスのみを認めるといった運用ルールも検討すべきでしょう。

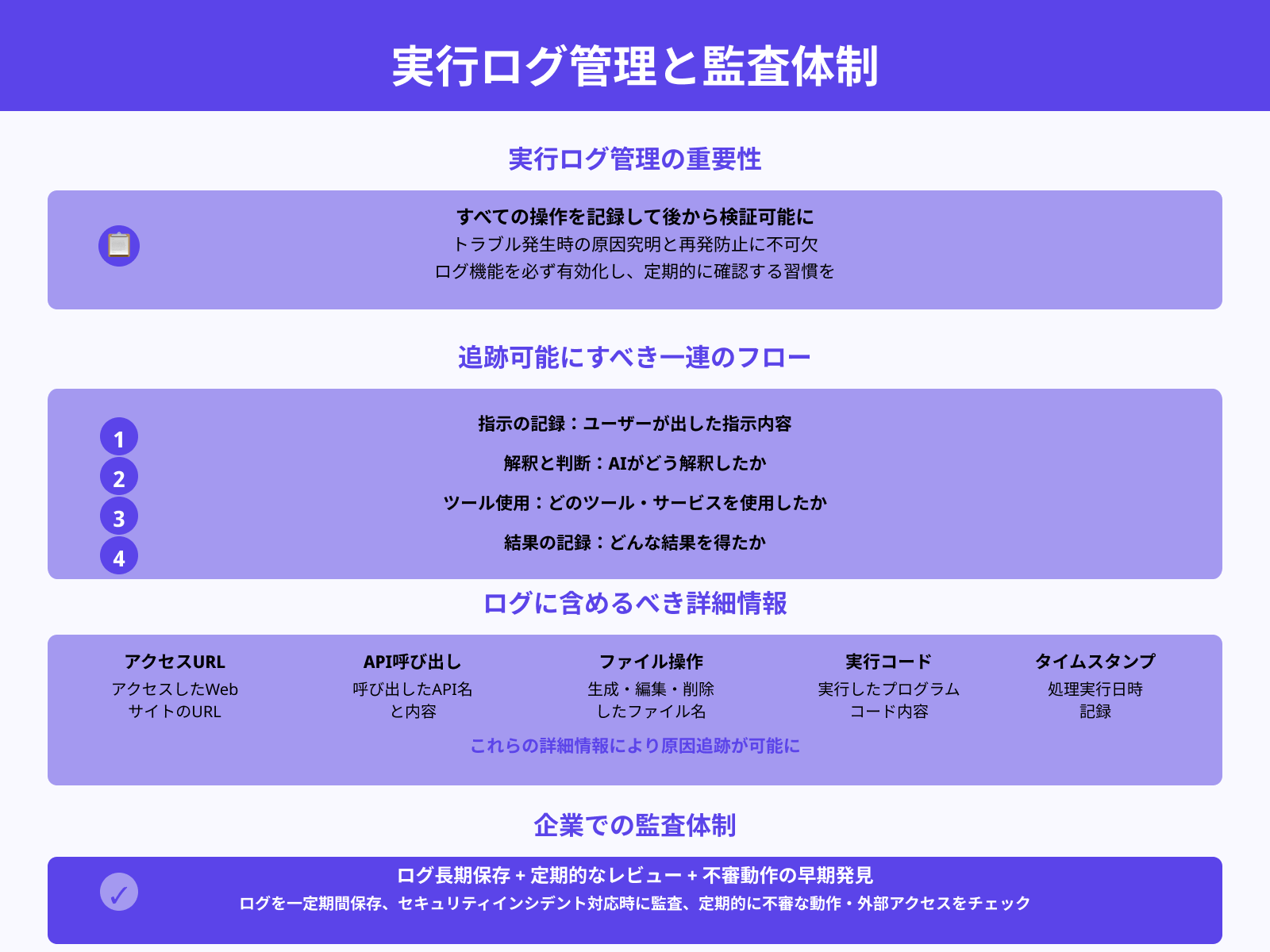

ログ・履歴を確認できる状態を必ず確保する

Manusが実行したすべての操作を記録し、後から検証できる体制を整えることは、トラブル発生時の原因究明と再発防止に不可欠です。

Manusには実行ログや処理履歴を保存する機能があるはずなので、これを必ず有効化し、定期的に確認する習慣をつけましょう。特に重要なのは、どのような指示を出し、Manusがどう解釈し、どのツールを使用して、どんな結果を得たかという一連のフローを追跡できることです。

ログには、アクセスしたWebサイトのURL、呼び出したAPI、生成・編集したファイル名、実行したコードなどの詳細情報が含まれることが理想的です。

企業での利用においては、これらのログを一定期間保存し、セキュリティインシデント発生時に監査できる体制を構築すべきです。また、定期的にログをレビューし、不審な動作や予期せぬ外部アクセスがないかをチェックすることで、問題を早期に発見できる可能性が高まります。

Manusの危険性を踏まえた業務利用の注意点

Manusを実際の業務で活用する際には、技術的な設定だけでなく、運用面での慎重な配慮が必要です。AIに任せすぎることなく、人間が適切に監督・管理する体制を構築することが、安全な業務利用の鍵となります。

ここからは、業務利用における注意点について次の内容を解説します。

それぞれ詳しく解説していきます。

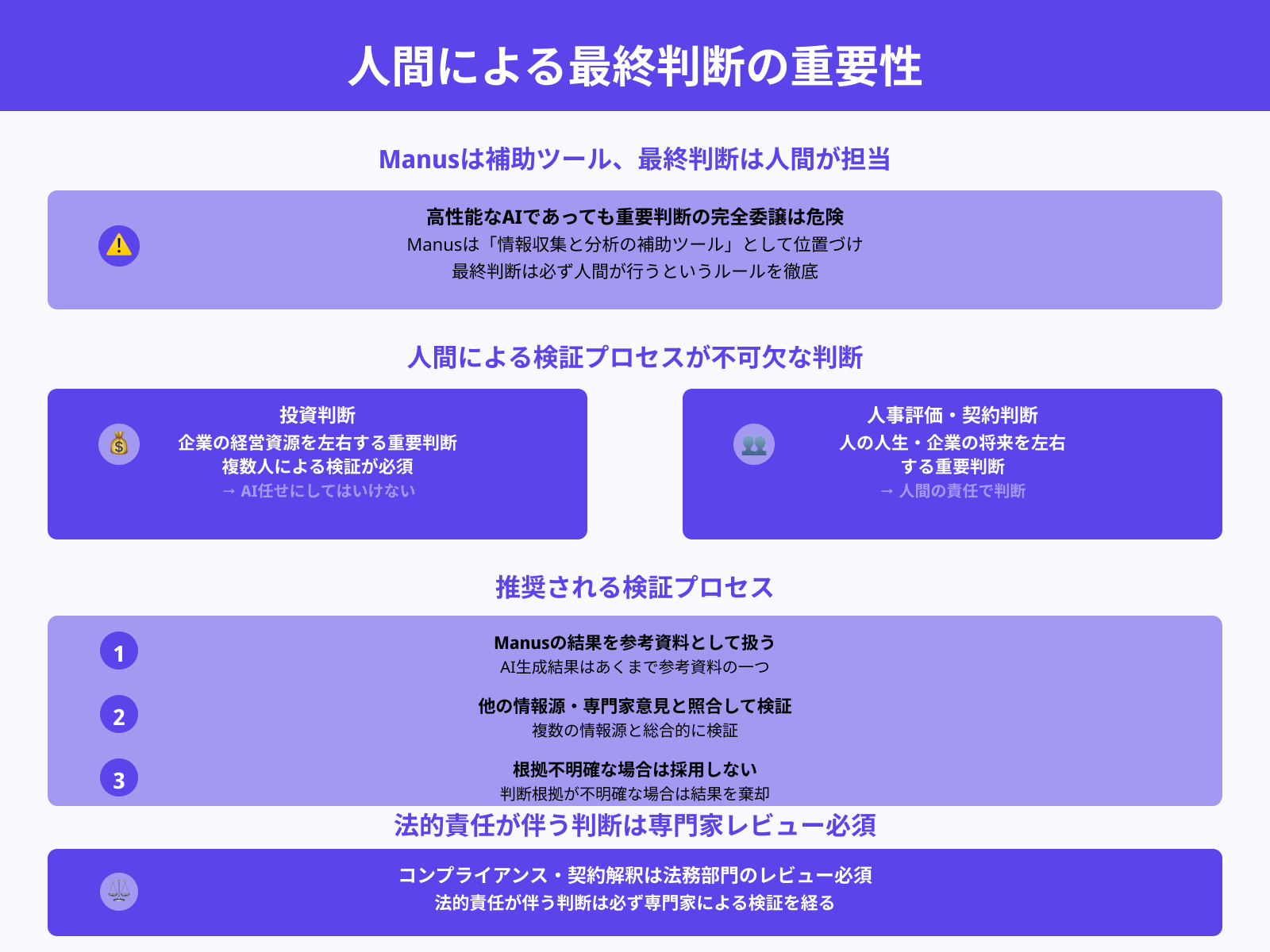

重要な判断は必ず人間が最終確認する

どれほど高性能なAIであっても、ビジネス上の重要な判断を完全に任せることは危険です。

Manusは情報収集と分析の「補助ツール」と位置づけ、最終判断は必ず人間が行うというルールを徹底すべきでしょう。

例えば、投資判断、人事評価、契約締結の可否判断など、企業の将来を左右する意思決定には、複数の人間による検証プロセスが不可欠です。

Manusが生成したレポートや分析結果は、あくまで参考資料の一つとして扱い、他の情報源や専門家の意見と照合して総合的に判断することが重要です。また、AIの判断根拠が不明確な場合や、論理的な説明が不足している場合には、その結果を採用しないという判断基準も設けるべきでしょう。

特に法的責任が伴う判断(コンプライアンス判断、契約内容の解釈など)については、必ず法務部門や専門家のレビューを経ることが不可欠です。

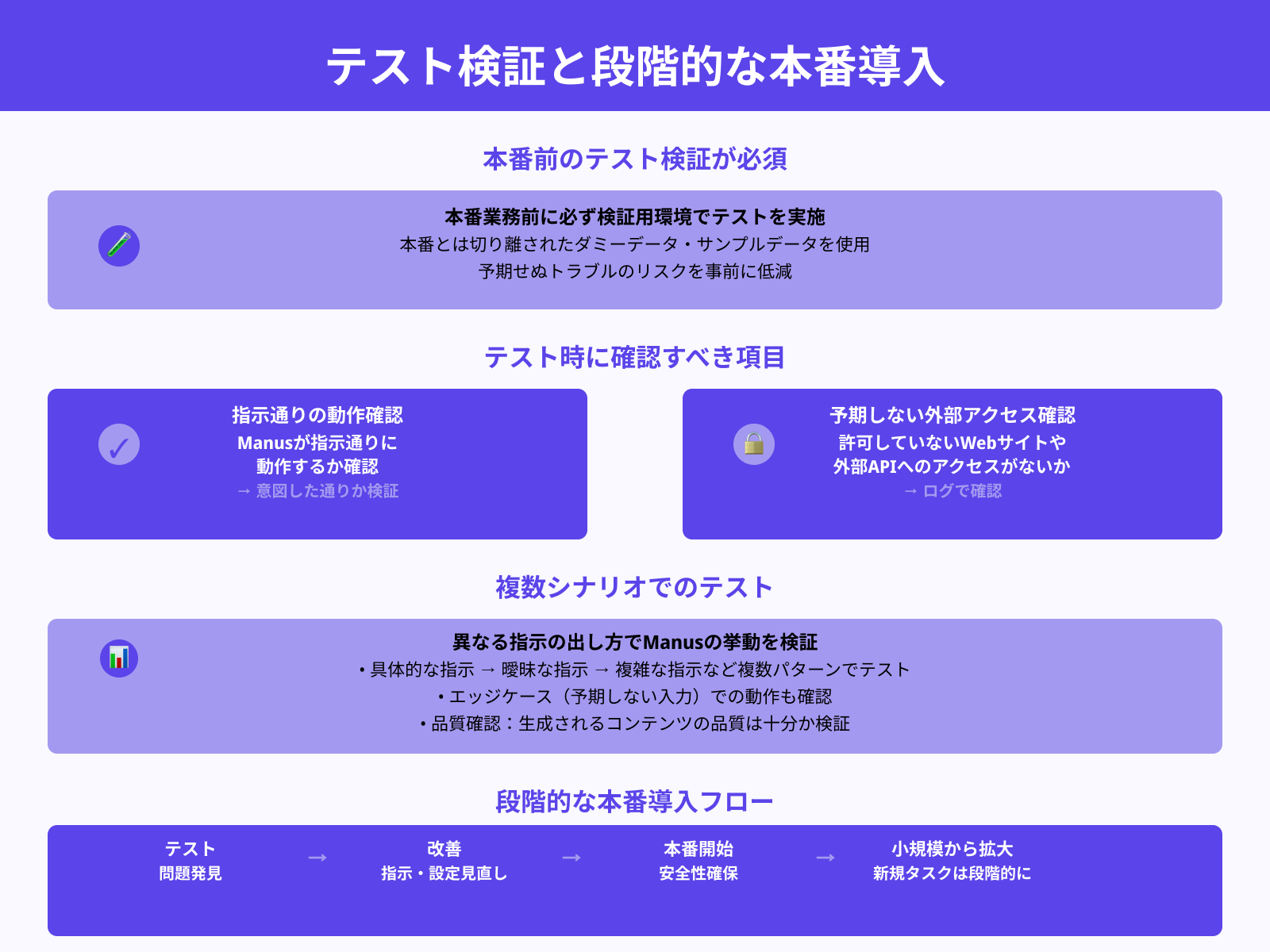

本番環境前に検証用環境でテストを行う

Manusを本番業務で使用する前に、必ず検証用環境でテストを実施することが重要です。

いきなり重要なデータや本番システムでManusを動作させることは、予期せぬトラブルのリスクを高めるからです。テスト環境では、本番とは切り離されたダミーデータやサンプルデータを使用し、Manusの動作を確認します。

特に確認すべき点は、指示通りに動作するか、予期しない外部アクセスをしないか、生成されるコンテンツの品質は十分か、といった項目です。複数のシナリオでテストを実施し、異なる指示の出し方でManusの挙動がどう変わるかを検証することも重要です。

テストで問題が見つかった場合は、指示の仕方を改善したり、設定を見直したりして、安全性を高めてから本番環境に移行します。また、本番運用開始後も、新しいタイプのタスクを実行する際には、まず小規模なテストから始めて徐々に拡大していくアプローチが推奨されます。

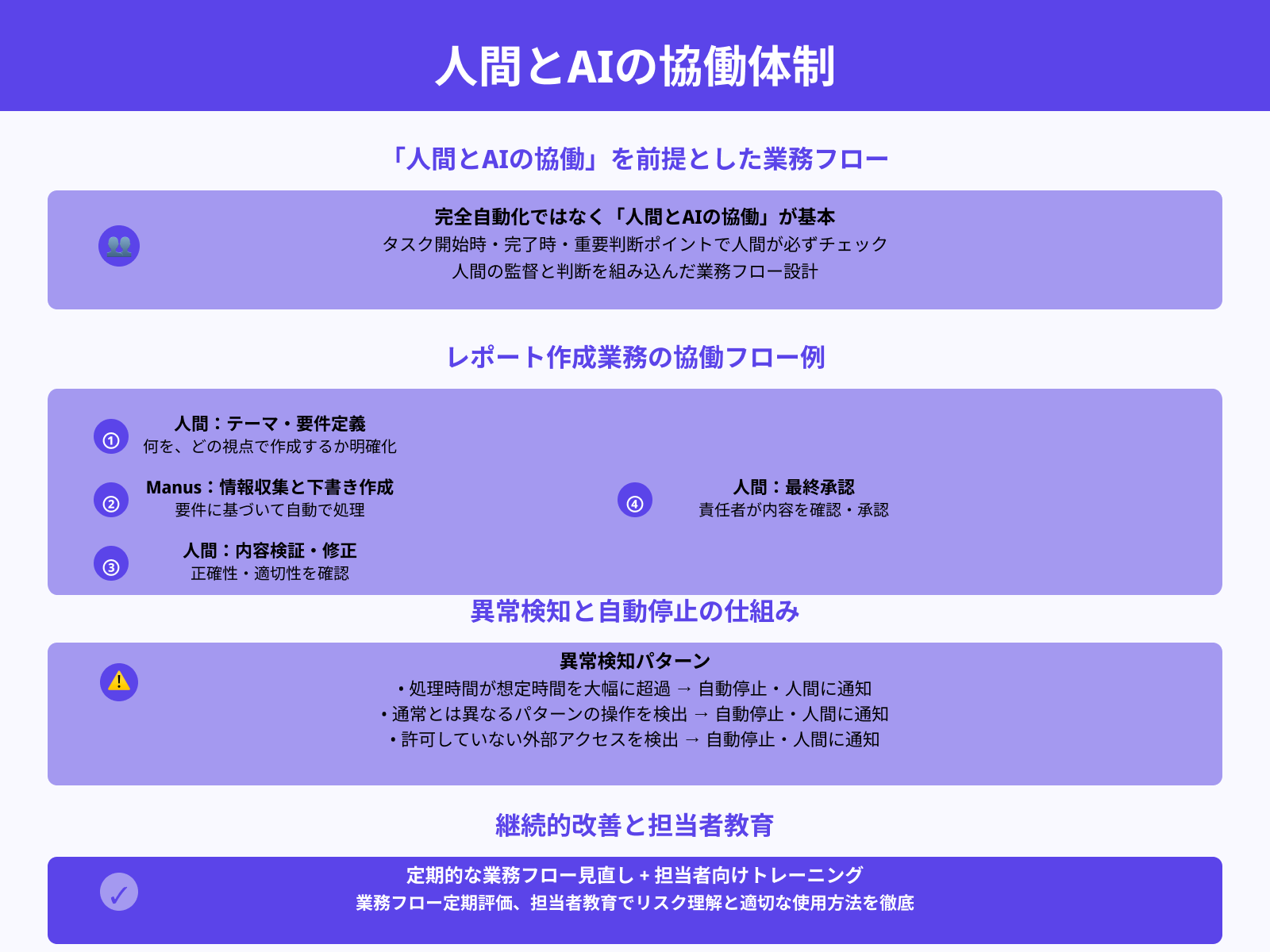

AI任せにしない業務フローの設計ルール

Manusを業務に組み込む際は「完全自動化」ではなく「人間とAIの協働」を前提とした業務フローを設計すべきです。

具体的には、タスクの開始時と完了時、重要な判断ポイントでは必ず人間がチェックを入れる仕組みを構築します。例えば、レポート作成業務であれば、①人間がテーマと要件を定義→②Manusが情報収集と下書き作成→③人間が内容を検証・修正→④最終承認、というフローが考えられます。

また、異常検知の仕組みも重要で、Manusの処理が想定時間を大幅に超えた場合や、通常とは異なるパターンの操作を検出した場合には、自動で処理を停止して人間に通知する設定が有効です。定期的に業務フローを見直し、Manusに任せすぎていないか、人間の監督が適切に機能しているかを評価することも必要です。

さらに、Manusを使用する担当者向けのトレーニングを実施し、リスクや適切な使用方法について理解を深めることで、より安全な運用が実現できるでしょう。

まとめ

Manusは革新的な自律型AIエージェントとして大きな可能性を秘めていますが、データ漏洩、予期せぬ動作、情報の正確性など多様なリスクも存在します。特に中国企業による開発という背景から、プライバシーやセキュリティに関する懸念が指摘されており、米国の一部州では使用が禁止されている状況です。

安全に活用するには、接続する外部サービスの最小化、権限の厳格な管理、ログの定期確認といった技術的対策が不可欠です。さらに、重要な判断は必ず人間が行う、本番前にテスト環境で検証する、AI任せにしない業務フローを設計するといった運用面での配慮も重要です。

Manusの高い自律性は業務効率化に貢献する一方で、適切な管理と監督なしでは危険性が高まります。リスクを正しく理解し、慎重な運用体制を構築することで、Manusの利点を活かしながら安全に活用できるでしょう。

今回解説した危険性を把握したうえで、Manusの料金やできることを詳しく知りたい人は、次の記事を参考にしてください。